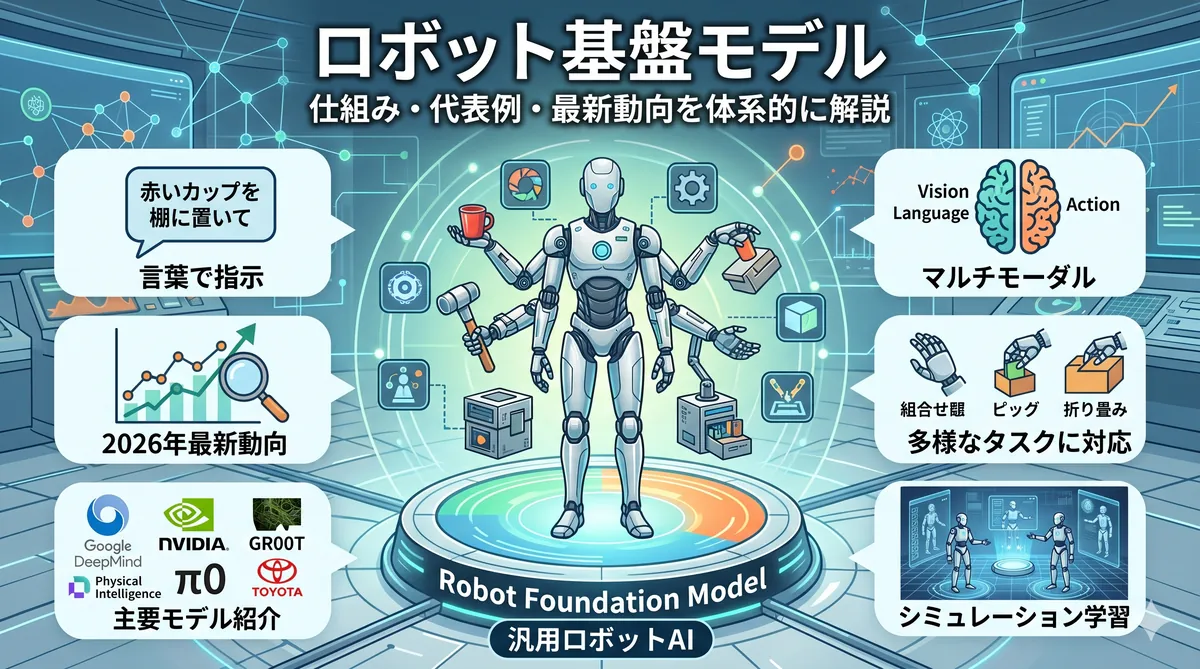

「ロボットに言葉で指示を出すだけで、未知の作業をこなしてくれる」——そんな未来を実現しようとしているのがロボット基盤モデル(Robot Foundation Model)です。ChatGPTに代表される大規模言語モデル(LLM)がテキスト生成の世界を変えたように、ロボット基盤モデルはロボットの動作生成を根本から変革しようとしています。

しかし「基盤モデル」という概念自体がまだ新しく、従来のロボットAIと何が違うのか分かりにくいという声も多いのが現状です。本記事では、ロボット基盤モデルの定義から技術的な仕組み、代表的なモデル、応用分野、そして2026年時点の最新動向まで、一次情報をもとに体系的に解説します。

- ロボット基盤モデルとは「1つのモデルで多様なタスク・環境に対応できる汎用ロボットAI」のこと

- VLA(Vision-Language-Action)アーキテクチャが中核技術として急速に発展中

- Google DeepMind、Physical Intelligence、NVIDIA、Toyotaなどが代表的なモデルを公開

- 製造業・物流・家庭・医療など幅広い分野への応用が始まっている

- 安全性の確保やデータ収集のスケーラビリティが今後の重要課題

ロボット基盤モデルとは?定義をわかりやすく解説

まずは「ロボット基盤モデル」の意味を正確に理解するところから始めましょう。この用語は、AI分野の「基盤モデル」という概念がロボティクスに適用されたものです。

基盤モデル(Foundation Model)の基本概念

基盤モデル(Foundation Model)とは、大量のデータで事前学習され、さまざまな下流タスクに適用できる大規模AIモデルのことです。2021年にスタンフォード大学HAI(Human-Centered AI)が公開した報告書で正式に定義されたこの概念は、以下のような特徴を持ちます。

- 大規模な事前学習: インターネット上のテキスト・画像・動画など膨大なデータで訓練される

- 転移学習による汎用性: 特定タスクに限定されず、微調整(ファインチューニング)やプロンプトで多様なタスクに対応できる

- 創発的能力: 訓練時には明示的に教えていない能力が、モデルの大規模化に伴って発現する

テキスト領域ではGPTシリーズやClaude、画像領域ではStable Diffusionなどが基盤モデルの代表例です。

ロボット基盤モデルが従来のロボットAIと異なる点

従来のロボットAIは、「ピッキング」「ドアの開閉」「歩行」など、1つのタスクに対して1つのモデルを設計・訓練するアプローチが主流でした。新しいタスクに対応するたびに、データ収集・モデル設計・訓練をゼロからやり直す必要があったのです。

これに対してロボット基盤モデルは、1つの大規模モデルで多様なタスク・環境・ロボットボディに対応することを目指します。具体的な違いを整理すると以下のようになります。

| 比較項目 | 従来のロボットAI | ロボット基盤モデル |

|---|---|---|

| 対応タスク数 | 単一〜少数 | 多数(数百〜) |

| 新タスクへの対応 | 再設計・再訓練が必要 | 少量データの微調整やゼロショットで対応 |

| 言語理解 | 限定的またはなし | 自然言語による指示を理解 |

| 学習データ | タスク固有のロボットデータ | ロボットデータ+インターネット上のテキスト・画像・動画 |

| 汎化能力 | 訓練環境に強く依存 | 未見の物体・環境への適応が可能 |

つまり、ロボット基盤モデルとは「テキストの世界でLLMが果たした革命を、物理世界のロボット動作で再現しようとするもの」と言えます。

ロボット基盤モデルが注目される背景

なぜ今、ロボット基盤モデルがここまで注目を集めているのでしょうか。その背景には、AI技術側の飛躍的進歩と、ロボット側の長年の課題の両方があります。

LLM・マルチモーダルAIの急速な発展

2022年のChatGPT登場以降、LLMの能力は爆発的に向上しました。さらにGPT-4Vに代表されるマルチモーダルモデル(テキスト・画像・音声など複数の情報を統合的に処理するAI)が登場したことで、「視覚情報を理解して言語で推論する」という能力が実用レベルに達しました。

この進歩はロボティクスに大きな示唆を与えました。もし言語と視覚の理解力を持つAIに「身体の動かし方」も教えれば、言語指示から直接ロボットの動作を生成できるのではないか——これがロボット基盤モデルの発想の出発点です。

ロボット分野が抱えていた「汎用化」の壁

ロボット分野には「データのスケールが圧倒的に足りない」という固有の課題がありました。テキストデータはインターネット上にペタバイト規模で存在しますが、ロボットの動作データは実機で1つずつ収集するしかなく、データ量がLLMの訓練データに比べて桁違いに少なかったのです。

この壁を突破するためのアプローチとして、以下の方法が同時並行で進みました。

- シミュレーションによる大量データ生成: 物理シミュレータ内で仮想ロボットを動かし、低コストで大規模なデータを作る

- インターネットデータの活用: YouTube動画やテキストから物理世界の知識を間接的に学習する

- 複数機関のデータ統合: 異なるロボット・環境のデータを1つのデータセットにまとめる(Open X-Embodimentなど)

これらの手法が成熟してきたことで、ロボット基盤モデルを現実的に構築できる条件が整いつつあります。

ロボット基盤モデルの仕組みと主要技術

ここからは、ロボット基盤モデルがどのような技術で成り立っているのか、やや踏み込んで解説します。

VLA(Vision-Language-Action)モデルとは

ロボット基盤モデルの中核を担うアーキテクチャがVLA(Vision-Language-Action)モデルです。これは名前のとおり、以下の3つのモダリティ(情報の種類)を統合的に扱います。

- Vision(視覚)

ロボットに搭載されたカメラの画像・映像。周囲の環境や操作対象を認識する - Language(言語)

ユーザーからの自然言語による指示。「赤いカップを棚に置いて」のようなタスク記述 - Action(動作)

ロボットの関節角度やエンドエフェクタの位置・力など、物理的な動作の指令

VLAモデルの基本的な処理フローは以下のようになります。

- カメラ画像をビジョンエンコーダで特徴量に変換する

- 言語指示をテキストエンコーダ(多くの場合、事前学習済みLLM)でトークン化する

- 視覚特徴量と言語トークンを統合し、Transformerベースのモデルで推論する

- 出力として、ロボットが次にとるべきアクション(関節角度の変化量など)を生成する

Google DeepMindのRT-2(Robotic Transformer 2)は、VLAモデルの先駆的存在として知られています。RT-2はVLM(Vision-Language Model)をベースに、ロボットの動作を「言語トークン」として表現することで、LLMの汎化能力をそのままロボット動作に転用するという画期的なアプローチを採用しました(RT-2公式ページ)。

シミュレーションから実機への転移学習

ロボット基盤モデルの訓練において、Sim-to-Real(シミュレーションから実環境への転移)は非常に重要な技術です。

物理シミュレータ(NVIDIA Isaac Sim、MuJoCoなど)内でロボットを何百万回も動かし、多様な状況でのデータを生成します。シミュレーション上ではロボットが壊れる心配もなく、24時間稼働でデータを大量生産できるため、実機だけでは到底集められない規模のデータセットが構築可能です。

ただし、シミュレーションと実環境には「リアリティギャップ」と呼ばれる差異があります。摩擦係数、照明条件、センサーノイズなどが異なるため、シミュレーションで学習したモデルがそのまま実機で動くとは限りません。このギャップを埋めるために、以下のような手法が用いられます。

- ドメインランダマイゼーション: シミュレーション内の物理パラメータや見た目をランダムに変化させ、多様な条件に対するロバスト性を獲得させる

- 少量の実機データでの微調整: シミュレーションで事前学習したモデルを、数十〜数百回の実機データでファインチューニングする

- フォトリアリスティックレンダリング: レイトレーシングなどの高品質レンダリングでシミュレーション画像の現実感を高める

大規模ロボットデータセットの整備

ロボット基盤モデルの発展を支えるインフラとして、大規模なオープンデータセットの整備が進んでいます。特に重要なのが、Google DeepMindが主導したOpen X-Embodimentプロジェクトです。

Open X-Embodimentは、世界中の21の研究機関から集められた22種類のロボットによる、100万以上のロボットエピソード(動作の記録)を統合したデータセットです(Open X-Embodiment公式ページ)。このデータセットを使って訓練されたモデル「RT-X」は、単一機関のデータで訓練したモデルと比べて50%以上の性能向上を示したと報告されています。

このように、異なるロボットプラットフォームのデータを横断的に学習することで、特定のロボットに依存しない汎用的な動作知識の獲得が可能になりつつあります。

代表的なロボット基盤モデル一覧【2026年版】

ここでは、2026年時点で特に注目されている主要なロボット基盤モデルを紹介します。まず概要を一覧表で整理し、その後に個別のモデルを詳しく解説します。

| モデル名 | 開発元 | アーキテクチャ | 主な特徴 |

|---|---|---|---|

| RT-2 / RT-X | Google DeepMind | VLA(VLMベース) | 自然言語指示で700以上のタスクに対応、Open X-Embodimentで訓練 |

| π0(pi-zero) | Physical Intelligence | VLA(Flow Matching) | 器用なマニピュレーション、複数のロボットプラットフォームに対応 |

| GR00T | NVIDIA | マルチモーダル基盤モデル | ヒューマノイドロボット特化、Isaac Simとの統合 |

| DFM | Toyota Research Institute | Diffusionベース | 人間のデモンストレーションから数時間で新スキル習得 |

| RoboCat | Google DeepMind | マルチタスク・マルチロボット | 自己改善ループで継続的にスキルを拡張 |

| Octo | UC Berkeley他 | Transformerベース | オープンソース、Open X-Embodimentで訓練 |

Google DeepMind RT-2 / RT-X

RT-2(Robotic Transformer 2)は、Google DeepMindが2023年に発表したVLAモデルです。PaLI-XやPaLM-Eといった大規模VLMをベースにしており、ロボットの動作指令をテキストトークンとして扱うことで、LLMの推論能力をロボット制御に直接活用します。

RT-2の最大の強みは、インターネット規模の知識をロボット動作に転移できる点です。例えば「テイラー・スウィフトの国の国旗に近い色の物体を拾って」のような、訓練データには含まれていない複雑な推論を伴う指示にも対応できることが示されました。

その後、Open X-Embodimentデータセットで訓練されたRT-Xが登場し、複数のロボットプラットフォームにまたがる汎用性がさらに向上しています。

Physical Intelligence π0

π0(パイゼロ)は、元Google Brain研究者らが設立したPhysical Intelligence社が開発したロボット基盤モデルです。2024年に発表されたこのモデルは、Flow Matching(拡散モデルの一種)をアクション生成に適用する独自のアプローチを採用しています(Physical Intelligence公式ブログ)。

π0は以下のような特徴を持ちます。

- 洗濯物をたたむ、テーブルを片付けるなど、長時間の複雑なマニピュレーションタスクに対応

- 複数メーカーの異なるロボットアーム・ハンドで動作可能

- 事前学習済みVLMの知識をロボット動作に効率的に転用

Physical Intelligence社はπ0の後継モデルの開発も進めており、2026年時点でもロボット基盤モデル分野をリードする存在の1つです。

NVIDIA GR00T

GR00T(Generalist Robot 00 Technology)は、NVIDIAがヒューマノイドロボット向けに開発した基盤モデルです。2024年のGTC(GPU Technology Conference)で発表され、自然言語・画像・動画を入力として、ヒューマノイドロボットの全身動作を生成します(NVIDIA GR00T公式ページ)。

NVIDIAは物理シミュレータIsaac Simやロボット学習プラットフォームIsaac Labと組み合わせることで、シミュレーション→実機転移のパイプライン全体を提供しています。この「ハードウェア(GPU)+シミュレータ+基盤モデル」の垂直統合アプローチは、NVIDIAならではの強みです。

Toyota Research Institute DFM

DFM(Diffusion Foundation Model)は、Toyota Research Institute(TRI)が開発した拡散モデルベースのロボット基盤モデルです。最大の特徴は、人間のティーチング(遠隔操作によるデモンストレーション)データから、わずか数時間で新しいスキルを学習できる点にあります。

TRIは「大規模な事前学習」と「少量データでの迅速な適応」の両立を重視しており、製造業の現場で求められる柔軟性と導入スピードを意識した設計思想が特徴的です。

その他の注目モデル

上記以外にも、ロボット基盤モデルの分野ではさまざまなプレイヤーが参入しています。

- Octo(UC Berkeley等): Open X-Embodimentデータで訓練されたオープンソースのロボット基盤モデル。研究コミュニティでの利用を目的とし、誰でも自由に改良・拡張できる

- RoboCat(Google DeepMind): 自己改善メカニズムを備え、100回程度のデモンストレーションだけで新しいタスクを学習できるモデル

- Genie 2(Google DeepMind): 動画生成モデルの技術を応用し、ロボットのシミュレーション環境そのものを自動生成するアプローチ

また、OpenAIやTesla、中国のUnitreeなども独自のロボット基盤モデルの開発を進めていると報じられており、2026年はこの分野の競争がさらに激化しています。

ロボット基盤モデルの応用分野と活用事例

ロボット基盤モデルは、その汎用性ゆえに幅広い分野への応用が期待されています。ここでは主要な応用分野ごとに、想定される活用シーンを整理します。

製造業・物流

製造業と物流は、ロボット基盤モデルの最も有望な適用先の1つです。

- 多品種少量生産への対応: 従来はロボットのプログラムを製品ごとに書き換える必要がありましたが、基盤モデルを用いれば「この部品をあの位置に組み付けて」といった言語指示で新しい作業に即座に対応できる可能性があります

- 倉庫ピッキングの汎用化: ECの拡大で取り扱い品目が爆発的に増える物流倉庫では、未見の商品にも対応できるロボットが求められています

- 品質検査の柔軟化: 視覚と言語の統合理解により、「傷がある製品を除外して」のような曖昧な指示にもロバストに対応

家庭・サービスロボット

「汎用家庭用ロボット」は長年のロボティクスの夢ですが、家庭環境は工場以上に不確実性が高く、実現が困難でした。ロボット基盤モデルは、この課題に正面から取り組むものです。

- 家事支援: 洗濯物をたたむ、食器を洗う、掃除するなど、多様な家事を1台のロボットでこなす

- 高齢者介護: 個々の利用者のニーズに応じた柔軟なサポート

- 接客・案内: ホテルや商業施設で、自然な対話をしながら物理的な作業も行うロボット

Physical Intelligenceのπ0が洗濯物をたたむデモを公開したことは、この分野における基盤モデルの可能性を広く認知させるきっかけとなりました。

医療・農業

医療分野では、手術支援ロボットやリハビリロボットへの応用が研究されています。基盤モデルによって、患者ごとに異なる身体条件に適応した動作制御が可能になると期待されています。ただし、医療分野は安全性・認証のハードルが極めて高いため、実用化にはまだ時間がかかるでしょう。

農業分野では、作物の種類・成長段階・天候条件など変動要素が多い環境で、汎用的に作業できるロボットへのニーズがあります。収穫ロボットや除草ロボットなどに基盤モデルの技術が組み込まれることで、多品種栽培への対応力が向上する可能性があります。

ロボット基盤モデルの課題と今後の展望

大きな可能性を秘めたロボット基盤モデルですが、実用化に向けてはまだ多くの課題が残っています。

安全性・信頼性の確保

LLMが時として「ハルシネーション(事実に基づかない出力)」を生じるように、ロボット基盤モデルも予期しない動作を生成するリスクがあります。テキスト出力の誤りは修正すれば済みますが、物理世界でのロボットの誤動作は、人の安全に直接関わります。

このため、以下のような安全対策の研究が進められています。

- 動作実行前にシミュレーションで安全性を検証する「セーフティフィルタ」

- 人間が常に介入・停止できる「ヒューマン・イン・ザ・ループ」設計

- モデルの判断根拠を可視化する説明可能性(Explainability)の向上

データ収集のスケーラビリティ

Open X-Embodimentのような取り組みは画期的ですが、LLMの訓練データ規模(数兆トークン)と比べると、ロボットの動作データはまだ桁違いに少ないのが現状です。

この課題に対するアプローチとして、以下が注目されています。

- 人間の動画からの学習: YouTube等の動画データから、人間の動作パターンを抽出してロボットに転用する研究

- 生成モデルによるデータ拡張: 画像・動画生成AIを活用して、訓練データのバリエーションを人工的に増やす

- 遠隔操作データの大規模収集: VR機器を使った遠隔操作で、人間が効率的にデモンストレーションデータを作成する仕組みの整備

オープンソース化と産業エコシステム

LLMの世界では、Meta社のLlamaシリーズをはじめとするオープンソースモデルがエコシステムの発展に大きく貢献しました。ロボット基盤モデルの分野でも、Octoのようなオープンソースプロジェクトが登場していますが、まだ商用グレードのオープンモデルは限られています。

今後、より多くのオープンソースのロボット基盤モデルが公開されれば、中小企業やスタートアップもロボットAIの開発に参入しやすくなり、産業全体の発展が加速すると考えられます。

2026年時点では、Google DeepMind、NVIDIA、Physical Intelligenceなどの大手プレイヤーに加え、各国のスタートアップや大学研究室が続々と独自のロボット基盤モデルを発表しており、この分野は今後数年で急速に成熟していく見込みです。

まとめ

本記事では、ロボット基盤モデルとは何かを、定義・技術的仕組み・代表モデル・応用分野・課題の各観点から解説しました。要点を改めて整理します。

- ロボット基盤モデルとは、大量のデータで事前学習され、1つのモデルで多様なタスク・環境・ロボットボディに対応できる汎用的なロボットAIのこと

- 中核技術はVLA(Vision-Language-Action)モデルで、視覚・言語・動作を統合的に処理する

- Google DeepMindのRT-2 / RT-X、Physical Intelligenceのπ0、NVIDIAのGR00T、ToyotaのDFMなどが代表的なモデル

- 製造業・物流・家庭・医療・農業など幅広い分野で応用が期待されている

- 安全性の確保とデータ収集のスケーラビリティが今後の重要課題

ロボット基盤モデルは、「特定のタスクしかできないロボット」から「指示に応じて何でもこなせるロボット」への転換を実現する鍵となる技術です。LLMがわずか数年でビジネスの在り方を変えたように、ロボット基盤モデルが物理世界のロボティクスを変革する日も、そう遠くないかもしれません。